Poskytování služeb nebo produktů využívajících umělé inteligence (AI) provází z právního hlediska mnoho specifik, se kterými se u obvyklých softwarových řešení nesetkáme. Nezáleží na tom, jestli poskytovatel nabízí k užívání samotný trénovaný model, vyvíjí řešení využívající AI na míru potřebám zákazníka, nebo svým zákazníkům zprostředkovává pouze výstup, kterého bylo dosaženo za pomoci umělé inteligence. Poskytovatelé řešení využívajících AI by měli vždy pamatovat na to, že jejich produkty jsou v mnoha ohledech odlišné od obyčejného software, zejména co se týče využívání zákaznických dat, odpovědnosti za škodu vzniklou spoléháním se na správnost výstupů AI, a také ochrany těchto výstupů před neoprávněným užíváním. Smluvní vztahy týkající se AI by tak neměly být ošetřovány obvyklými softwarovými smlouvami, jelikož tyto nemusí stranám poskytovat dostatečnou právní ochranu a jistotu.

Tento článek popíše specifika smluvních vztahů týkajících se umělé inteligence a navrhne způsoby, jakými lze na potenciální problémy ve smluvních vztazích s AI reagovat, a to jak technicky, tak z právní stránky. Právní závěry tohoto článku budou dále prokládány statistikami a praktickými postřehy získanými při rozhovorech se zástupci jedenácti IT společností pracujících s umělou inteligencí.

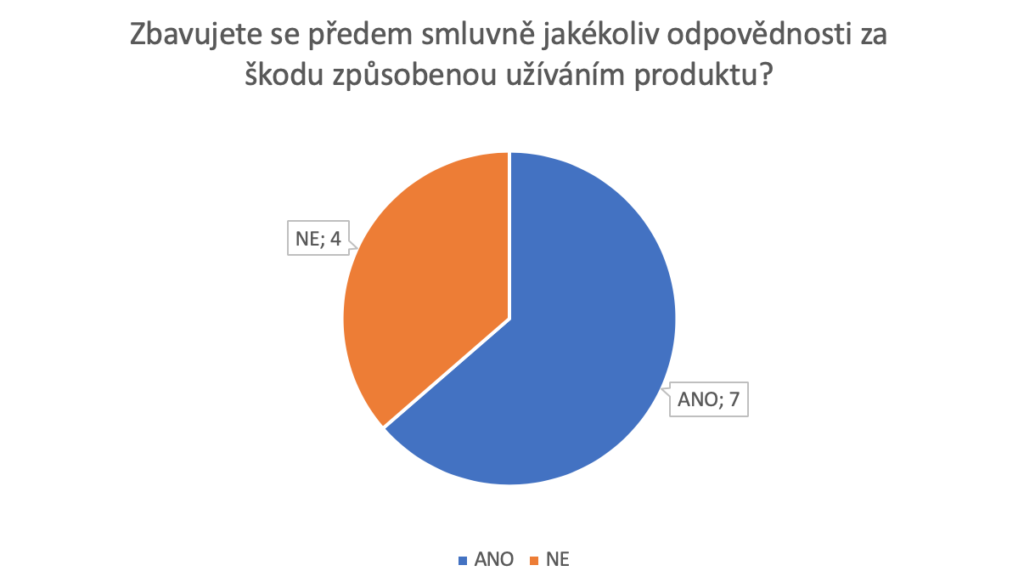

Některé aspekty odpovědnosti za škodu jsou v občanském zákoníku upraveny kogentně, což mimo jiné znamená, že je nelze prostřednictvím smlouvy nebo obchodních podmínek nastavit odlišně. Například smluvně nelze předem vyloučit nebo omezit povinnost k náhradě škody způsobené člověku na jeho přirozených právech, způsobené úmyslně nebo z hrubé nedbalosti, stejně jako nelze předem vyloučit nebo omezit právo spotřebitele na náhradu jakékoli újmy. K takovýmto smluvním ujednáním se nepřihlíží, tedy jako by neexistovala. Navzdory tomu je smluvní úprava odpovědnosti za škodu důležitým aspektem poskytování služeb AI.

7 z 11 dotazovaných společností poskytujících služby nebo produkty AI uvedlo, že se smluvně předem zbavuje jakékoliv odpovědnosti za škodu způsobenou užíváním jejich produktu.

Jejich záměrem přitom není zbavit se povinnosti hradit škodu způsobenou úmyslným nebo nedbalým jednáním. Mnohem častěji se obávají vzniku škody, kterou nemohou předvídat, nebo jejímuž vzniku nedokážou zamezit. Poskytovatelé AI, kteří svým zákazníkům nabízí přímo software využívající umělé inteligence, totiž nejenže nemohou vykonávat nad činností AI dohled v reálném čase (často se navíc předpokládá, že AI operuje nezávisle), ale někdy dokonce předem počítají s tím, že AI není bezchybná, a proto uvádí míru její (ne)spolehlivosti.

Naopak v jiných případech si poskytovatelé AI nemohou dovolit inzerovat svůj produkt jako v určité míře chybový (například autonomní vozidlo, jehož hlavním lákadlem by měl být jízdní komfort a bezpečnost), ale naopak si zakládají na jeho spolehlivosti a poskytují na jeho správné fungování záruku.

Je tedy zřejmé, že co do odpovědnosti za škodu způsobenou systémem AI, lze rozlišit alespoň dva obchodní modely. V prvním případě uvádí poskytovatel AI na trh řešení s tím, že se chce v co nejvyšší možné míře zbavit odpovědnosti za škodu způsobenou jeho nesprávným fungováním. V druhém případě si poskytovatel AI nemůže dovolit svou odpovědnost vyloučit, a tak je nucen na trh přijít s řešením, na které poskytuje určitou formu záruky, tedy chce nebo je nucen odpovídat za škodu způsobenou provozem takového systému.

V případě, že je poskytován systém AI a zájmem poskytovatele je se v co nejvyšší možné míře zbavit odpovědnosti za případnou škodu, která může být užíváním systému způsobena, bude pro poskytovatele výhodnější postavit svůj obchodní model na tom, že svým zákazníkům nebude slibovat žádný výsledek ani záruku, nýbrž pouze určitý standard of care. Například software určený k detekování vad materiálu může inzerovat jako službu poskytující kvalifikovaný odhad na základě poskytnutých informací, jejíž výstup však není určen jako doporučení pro jakékoliv závazné rozhodování (například považování materiálu za bezvadný). Nebo aplikaci sloužící jako osobní lékař schopný diagnostikovat na základě poskytnutých informací nemoc lze poskytovat s upozorněním, že neslouží jako náhrada za poskytnutí lékařských služeb lidským odborníkem.

V takových případech je vhodné sjednat omezení odpovědnosti za škodu jak ve vztahu k náhradě škody způsobené porušením smluvní, tak zákonné povinnosti.

Je však nutné pamatovat na to, že není možné překročit limity omezení odpovědnosti stanovené zákonem.

Druhou možností je neomezit odpovědnost poskytovatele jako takovou, ale pouze její rozsah. Typicky tak může být součástí smlouvy ujednání, že poskytovatel odpovídá za škodu způsobenou užíváním služby pouze do určité peněžní částky. Omezenou míru odpovědnosti zvolily také 2 dotazované společnosti. Tyto společnosti garantují určitou míru správnosti jimi poskytovaných služeb a za způsobenou škodu odpovídají pouze, pokud poměr nesprávných výsledků k výsledkům správným překročí garantovanou hranici. Takovou smluvní úpravu lze ilustrovat na příkladu systému sloužícího k převodu řeči na text, pro který poskytovatel garantuje správnost 90 % převedených slov ve vzorku normostrany souvislého textu. Odpovědnost mezi smluvními stranami může být nastavena tak, že poskytovatel se podílí na odpovědnosti za škodu způsobenou užíváním služby a zákazník má právo na poskytnutí náhrady, pouze pokud míra nesprávně převedených slov překročí stanovený limit.

Jak již však bylo zmíněno výše, v některých případech není možné odpovědnost za škodu vyloučit ani omezit, ať už z důvodů zákonných nebo obchodních. I přesto však může být v zájmu poskytovatele AI stanovit své odpovědnosti určité limity a konzultovat s právníkem, jakým jiným způsobem je možné omezit nechtěné důsledky případných pochybení produktu.

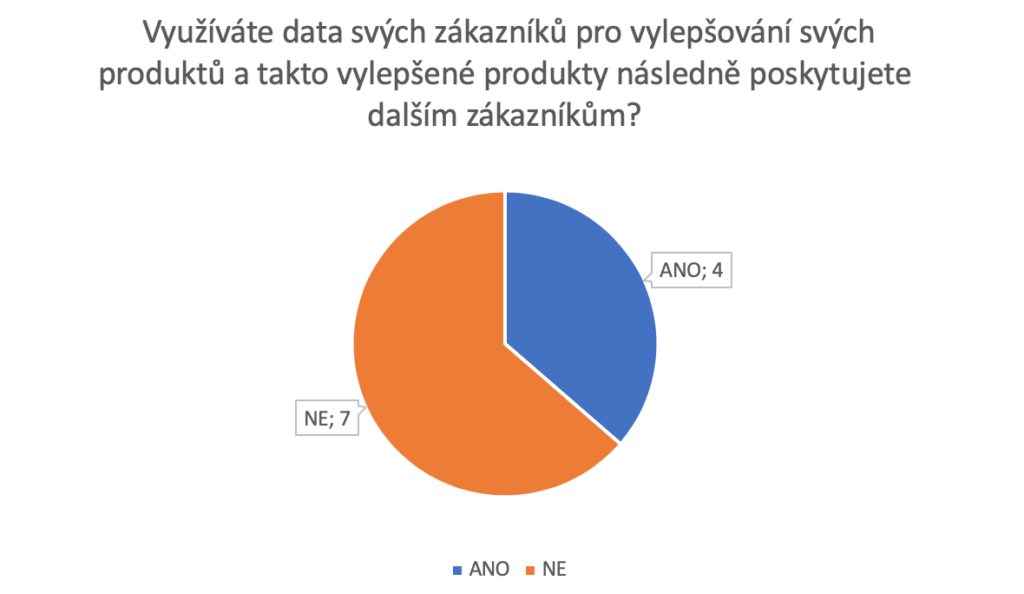

Data jsou zásadní ingrediencí pro strojové učení. Tato skutečnost však není jediným důvodem, proč by smluvní úprava jejich získávání a užívání neměla zůstat opomenuta. Stejně jako u zpracování osobních údajů nebo užívání autorských děl, i užívání dat by vždy mělo být podloženo určitým právním důvodem. Data využívaná při strojovém učení jsou totiž velmi často chráněna databázovými právy nebo obchodním tajemstvím a jejich zneužití by mohlo představovat dokonce nekalosoutěžní jednání. Proto by mělo být předání a užívání dat vždy podloženo písemnou dohodou stran.

V obecné rovině lze souhlas s užíváním dat dovozovat v případě, kdy zákazník předá data poskytovateli AI v souvislosti s plněním smlouvy. V takovém případě je možné dovodit, že zákazník poskytuje svá data za účelem poskytnutí objednávané služby. Vyvstává však otázka, jestli je poskytovatel AI taková data oprávněn využít i pro jiné účely, například pro vývoj jiných produktů pro osobní potřebu nebo pro další zákazníky. Vodítkem pro rozsah oprávnění poskytovatele AI k dalšímu využívání dat může být například skutečnost, jestli poskytovatel vyvíjí pro zákazníka řešení, ke kterému bude zákazníkovi poskytnuta výhradní nebo nevýhradní licence.

Ve většině případů je však nutné počítat s tím, že i když zákazník udělí souhlas s užíváním poskytnutých dat pro účely plnění smluvních povinností, nebude takovýto souhlas postačovat k tomu, aby mohl poskytovatel AI data dále využívat ve svůj vlastní prospěch nebo prospěch třetích osob.

Ačkoliv si byla většina dotazovaných poskytovatelů AI této skutečnosti vědoma,

4 z 11 dotazovaných společností uvedly, že data svých zákazníků využívají pro vylepšování svých produktů a takto vylepšené produkty následně poskytují dalším zákazníkům.

Jak již však bylo výše uvedeno, pro takové jednání je nutné sjednat si od poskytovatele dat příslušná oprávnění. Bez příslušného oprávnění se příjemce dat vystavuje nebezpečí, že po něm bude poskytovatel dat požadovat ukončení využívání dat, náhradu škody nebo vydání bezdůvodného obohacení. Aby se tedy předešlo budoucím sporům, doporučujeme stranám v jejich smluvní dokumentaci výslovně upravit možnosti a účel užívání předaných dat. Zamezit neoprávněnému nakládání s daty je především v zájmu objednatele služeb AI. Jednak se objednatel obává o své obchodní tajemství a jednak nechce, aby jeho data sloužila i ve prospěch jeho konkurence. Naopak zájmem poskytovatele AI zase bývá si poskytnutá data ponechat a zkvalitňovat s jejich pomocí úroveň svých služeb.

Mimo výše uvedené však může nastat situace, kdy zákazník poskytovateli předá ke zpracování data, ke kterým nemá dostatečná nebo dokonce žádná užívací práva. Popřípadě mohou poskytnutá data obsahovat osobní údaje, autorská díla nebo jiné prvky chráněné právy třetích osob, například právy pořizovatele databáze. Tyto oprávněné osoby se následně mohou obrátit na uživatele dat a požadovat po něm náhradu škody, která jim vznikla jejich neoprávněným užíváním. Z tohoto důvodu bude v zájmu poskytovatele, aby se zákazník zavázal uspokojit za poskytovatele případné nároky třetích stran a poskytl mu před nimi dostatečnou obranu. Poskytovatelům služeb AI tedy lze doporučit, aby vždy požadovali po svých zákaznících prohlášení, že jsou pořizovatelem databáze nebo že jsou oprávněni poskytnout oprávnění k užívání dat. Porušení takového prohlášení lze navázat na smluvní pokutu ve prospěch poskytovatele nebo na závazek odškodnit a vést účinnou obranu před nároky třetích stran.

Smluvní úprava nakládání s daty si tedy zaslouží přinejmenším stejně pozornosti, jako úprava odpovědnosti za škodu. Ať už jste v pozici poskytovatele nebo příjemce dat, vždy je vhodné zkontrolovat podmínky sjednaných oprávnění k užívání dat a důkladně se zamyslet nad jejich důsledky.

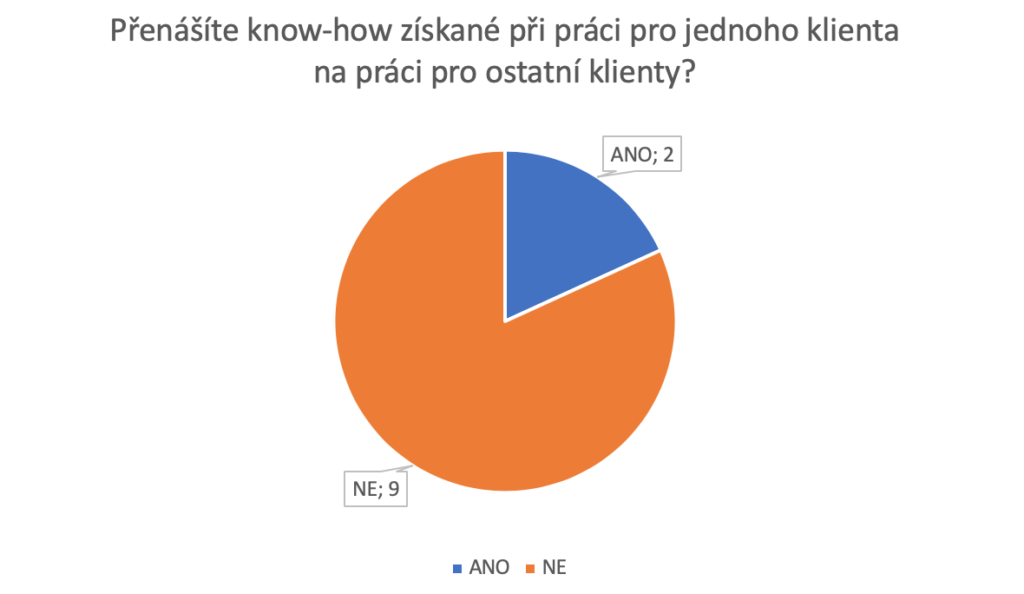

S daty získanými od zákazníků souvisí také know-how, které si poskytovatel odnese v souvislosti s plněním pro zákazníka. Například se může jednat o osvědčené postupy nebo zjištěné závislosti mezi sledovanými faktory. V tomto ohledu je zajímavé, že většina dotazovaných společností uvedla, že získané know-how nepřenáší na práci pro ostatní klienty. Jako důvod společnosti uvedly, že si jednak nejsou jisti legálností takového jednání a jednak jim nepřijde spravedlivé přenášet know-how naučené při práci pro jednoho zákazníka ve prospěch jeho konkurence.

9 z 11 dotazovaných společností uvedlo, že know-how získané při práci pro jednoho klienta (například zjištěné závislosti mezi sledovanými faktory ve zkoumaných datech) nepřenáší na práci pro ostatní klienty.

Z právního hlediska však know-how nenáleží zákazníkovi, ale samotnému poskytovateli služeb. Je pak pouze na poskytovateli, jestli bude zjištěné know-how používat i ve prospěch jiných zákazníků a své služby tak bude o zjištěné poznatky zkvalitňovat, nebo jestli bude při práci pro nového zákazníka postupovat vždy od začátku a zvláštní poznatky využije jen v takovém případě, kdy vyplynou na povrch v souvislosti s prací pro daného zákazníka. Například v právní oblasti však bývá pravidlem, že advokát přenáší poznatky zjištěné z práce pro jednoho klienta i na práci pro ostatní klienty a neustále tak zkvalitňuje své služby.

Jedním ze způsobů ochrany algoritmů AI, u kterých hrozí jejich zneužití konkurencí, je patentová ochrana. Patentové řízení je však časově i finančně náročné. Zejména pro menší společnosti neschopné konkurovat softwarovým gigantům tak není nejvhodnějším způsobem ochrany jejich AI. Pokud se společnost rozhodne nepatentovat si své softwarové řešení a nevadí jí odhalit principy fungování jejího řešení, může účinně zabránit konkurenci, aby řešení patentovala namísto ní. Toho lze docílit tak, že klíčové principy fungování svého řešení zveřejní, například prostřednictvím článku vydaného v odborných kruzích. Kromě patentové ochrany je dále možné chránit AI autorským právem a propracovanou licenční smlouvou, ujednáním o mlčenlivosti, obchodním tajemstvím, technickými prostředky ochrany (DRM), cloud computingem a do určité míry také prostřednictvím správní a trestněprávní odpovědnosti.

Umělou inteligenci jakožto počítačový program dále chrání autorská práva. Při předávání AI zákazníkům je však vhodné chránit se před nežádoucím užíváním licenční smlouvou. Licenční smlouva by v takovém případě především neměla opomenout určení povolených a zakázaných způsobů užití AI.

Mezi způsoby užívání, kterým chce poskytovatel AI obvykle zabránit, patří změny a úpravy software, provádění reverse engineering, dekompilace nebo jiné způsoby získání zdrojového kódu, pokusy o prolomení bezpečnostních opatření software, nebo vytváření či podílení se na vytváření software, který je založený na poskytované AI.

Zvláštní pozornost si však zaslouží ochrana AI prostřednictvím jejích výstupů. Na rozdíl od zdrojového kódu AI, který je jako počítačový program chráněn autorským právem vůči všem subjektům, výstupy AI nemusí být autorskými díly. Jako na takové se na ně tedy nevztahuje univerzální autorskoprávní ochrana. Ať už je výstupem AI poskytovaným zákazníkovi analýza, rada nebo jiným způsobem zpracovaná data, může být v zájmu poskytovatele AI omezit rozsah poskytovaných dat a umožněných způsobů nakládání s výstupem AI.

Důvodem pro takové omezení je nejen zabránění dalšímu šíření těchto výstupů, ale také ochrana před zpětnou rekonstrukcí fungování modelu AI. Většina vývojářů AI však výstupy své AI nechrání, což potvrdilo 8 z 11 dotazovaných společností. Tyto společnosti odůvodnily nechránění výstupů AI tím, že spoléhají, že se žádné konkurenci nevyplatí nebo nepovede jejich řešení napodobit a že ani jejich zákazníci nebudou hledat konkurenčního dodavatele, jelikož je jim služba zakládající se na AI poskytována v rámci širšího vysoce personalizovaného balíčku služeb.

Na druhou stranu, 2 z 11 dotazovaných společností uvedly, že se obávají možnosti, že bude konkurence schopná provést reverse engineering a vyvinout konkurenční AI s podobnými funkcemi, nebo že bude schopná svou vlastní AI zkalibrovat a bez nutnosti vynaložení srovnatelných investic tak poskytovat konkurenční služby.

Taková možnost může nastat zejména v případě, kdy osoba disponuje jak vstupními, tak výstupními daty AI. Reverse engineering je však velmi obtížné, ne-li nemožné prokázat. Z tohoto důvodu jsou technické prostředky ochrany výstupů AI mnohem účinnější než prostředky právní. I přesto však právní ochrana AI a jejích výstupů může představovat významnou pojistku, zejména v případech, kdy je software obsahující AI předáván k dispozici zákazníkovi, nebo kdy zákazník disponuje jak vstupními, tak výstupními daty AI. V zájmu poskytovatele AI by proto vždy mělo být nastavit své licenční podmínky tak, aby svým zákazníkům neumožňoval využívat AI a její výstupy způsobem, který by mu do budoucna mohl způsobit újmu nebo ušlý zisk. Otázka však zní, jakým způsobem je možné umělou inteligenci a její produkty chránit?

Na akademické půdě se již po delší dobu vede debata o tom, zdali mohou výstupy AI představovat autorská díla a jako taková být chráněny autorským právem. Rovněž je otázkou, kdo by měl být autorem děl vytvořených umělou inteligencí. Ačkoliv veškeré související úvahy prozatím zůstávají pouze v teoretické rovině a nejsou podloženy právními předpisy ani rozhodovací praxí soudů, lze obecně tvrdit, že určení, jestli je konkrétní výstup AI autorským dílem, bude záviset na konkrétních okolnostech případu. Pokud by v konkrétním případě byl výstup AI autorským dílem, bylo by možné na takové dílo nahlížet jako na spoluautorské dílo autora AI a uživatele, který poskytl do přednastaveného rámce svá data. Podle jiných úvah lze na AI díla nahlížet jako na autorská díla, pouze pokud do jejich vytváření zasáhl vlastním tvůrčím způsobem člověk. Světlo do problematiky AI jako držitele práv vneslo i nedávné rozhodnutí Evropského patentového úřadu, který zamítl patentovou přihlášku, ve které byl jako vynálezce uveden systém AI.

Kvůli obecnosti právní úpravy a nedostatku soudních rozhodnutí v této oblasti si na závazné posouzení těchto otázek budeme muset prozatím počkat. Do té doby však není vhodné spoléhat se pouze na to, že výstupy AI jsou chráněny autorským právem. Namísto toho lze využít technických prostředků ochrany a neposkytovat nikomu zároveň datové vstupy i výstupy AI. Taková praktika však nemusí být vždy realizovatelná, zejména v případě, kdy poskytovatel dodává výstupy AI na základě dat poskytnutých zákazníkem. I v takovém případě je však stále možné výstupy AI modifikovat a poskytovat zákazníkovi např. interpretovaný výsledek analýzy namísto kompletních výstupních dat.

SHRNUTÍ

Z jednoho úhlu pohledu lze na umělou inteligenci nahlížet jako na pouhý počítačový program. Z právního hlediska jsou však služby využívající umělé inteligence hned v několika ohledech specifické. Článek poukázal na to, že zejména v oblasti odpovědnosti za vady, užívání klientských dat a právní ochrany si smlouvy týkající se umělé inteligence zaslouží zvláštní pozornosti.